Ataque no LiteLLM expõe falha crítica na cadeia de suprimentos de IA

Segurança em IA no centro das atenções

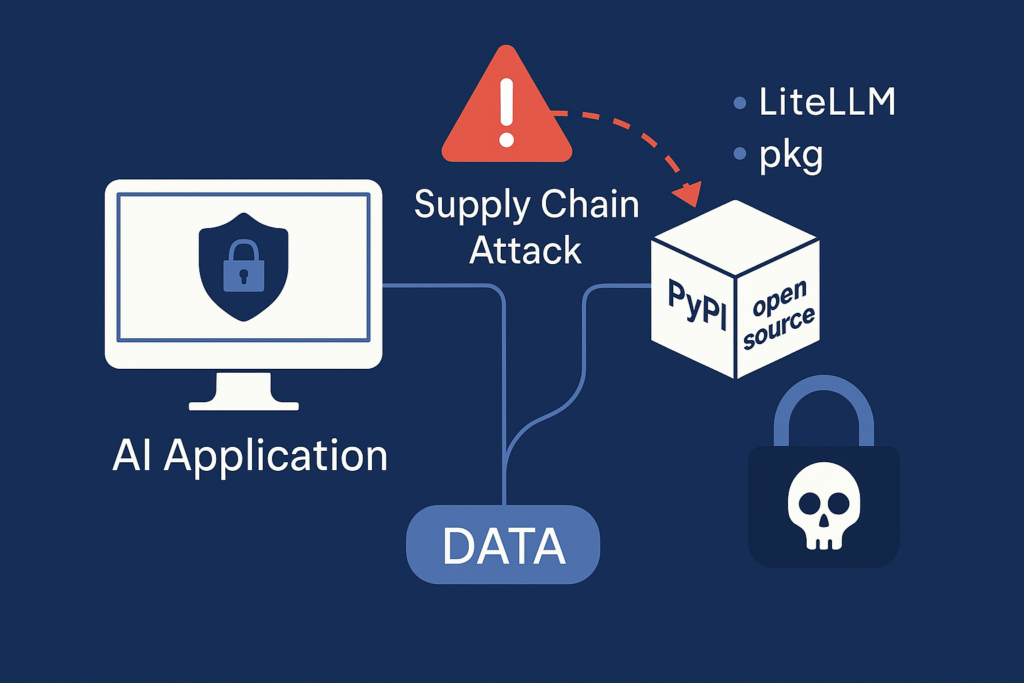

Recentemente, a comunidade de tecnologia voltou sua atenção para um incidente de segurança envolvendo o LiteLLM, biblioteca amplamente utilizada para integração e gerenciamento de Large Language Models (LLMs). O caso trouxe à tona um tema cada vez mais relevante: os riscos da cadeia de suprimentos em projetos de inteligência artificial.

O LiteLLM é usado por desenvolvedores e empresas para conectar aplicações a diferentes provedores de IA, como OpenAI, Azure e Anthropic. Justamente por essa popularidade, ele se tornou um alvo atrativo em um ataque que explorou o ecossistema de distribuição de pacotes open source.

O que aconteceu com o LiteLLM?

O incidente envolveu a publicação de versões maliciosas do pacote LiteLLM no repositório PyPI, principal fonte de distribuição de bibliotecas Python. Essas versões continham código não autorizado que poderia ser executado no momento da instalação ou uso da biblioteca.

Na prática, o risco incluía:

- Exposição de variáveis de ambiente

- Possível vazamento de chaves de API

- Execução de código em ambientes corporativos

- Comprometimento de aplicações de IA em produção

Embora o problema tenha sido identificado e tratado, o episódio serve como um alerta importante para todo o ecossistema de IA.

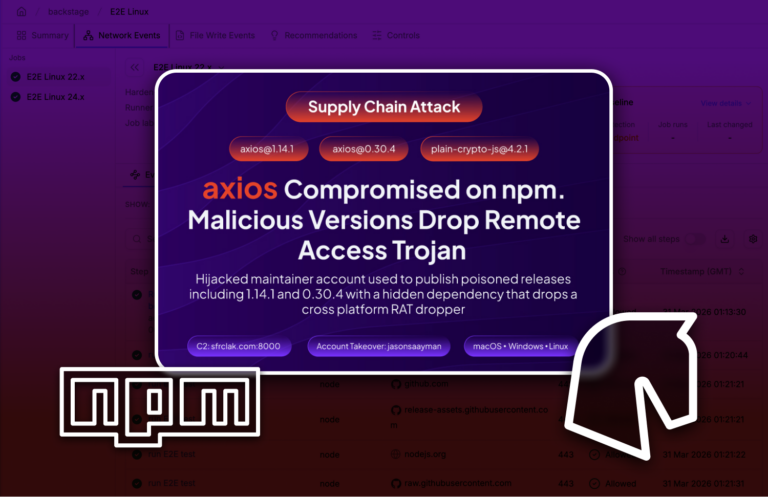

Por que ataques à cadeia de suprimentos preocupam tanto?

Ataques à cadeia de suprimentos não exploram falhas diretas no sistema final, mas sim a confiança em componentes de terceiros. Em projetos de IA, isso é ainda mais sensível porque:

- Ambientes de IA costumam ter acesso a dados estratégicos

- LLMs dependem de múltiplas bibliotecas e integrações

- Atualizações automáticas podem introduzir riscos sem aviso prévio

Com isso, uma única dependência comprometida pode impactar diversas aplicações ao mesmo tempo, ampliando significativamente o alcance do ataque.

O que empresas podem aprender com esse caso?

O episódio do LiteLLM reforça algumas boas práticas essenciais para quem trabalha com IA:

- Monitorar e validar dependências open source

- Evitar atualizações automáticas sem controle

- Implementar políticas de segurança específicas para MLOps e LLMOps

- Tratar bibliotecas de IA como ativos críticos de negócio

Mais do que nunca, segurança e inteligência artificial precisam caminhar juntas desde o início do projeto.

Segurança que acompanha a evolução da IA

Na Task, entendemos que inovar com IA exige confiança. Casos como esse mostram que não basta olhar apenas para o modelo ou para a performance — é fundamental garantir que dados, integrações e infraestrutura estejam protegidos em todas as camadas.

Por isso, a segurança da informação é tratada como prioridade: desde a governança até a operação, ajudamos empresas a adotar IA de forma responsável, segura e sustentável.

👉 Com a Task, seus dados, seus modelos e sua estratégia de IA são sempre o mais importante.

Fonte: FutureSearch